O Brasil realizou eleições municipais em outubro de 2024 sob novas regulamentações eleitorais rigorosas que proibiram campanhas de utilizarem conteúdo gerado por IA sem identificação, em um esforço para combater a desinformação impulsionada por IA. O DFRLab monitorou o cenário eleitoral ao longo de seis meses e encontrou evidências de deepfakes circulando em diversos formatos, incluindo imagens, áudios e vídeos, em plataformas como Facebook, Instagram, X, TikTok, YouTube e WhatsApp. Foram identificados setenta e oito casos de conteúdo diretamente relacionado a candidatos locais que foram confirmados ou alegados como sintéticos, destacando o potencial da IA generativa de comprometer a integridade do cenário eleitoral.

Quase 80% dos casos identificados se enquadram em pelo menos uma das seis táticas:

Deepfakes pornográficos direcionados a candidatas mulheres

Conteúdo manipulado acusando falsamente candidatos de crimes como corrupção, suborno ou má conduta

Apropriação da imagem de figuras da mídia e relatórios jornalísticos para disseminar informações falsas que prejudicam a reputação de um candidato

Apropriação da imagem de políticos brasileiros proeminentes para apoiar falsamente um candidato ou prejudicar a candidatura de outra pessoa

Conteúdo manipulado por IA sobre eventos políticos, como datas de comícios ou o número de candidatos e partidos em uma cédula

Deepfakes políticos satíricos e humorísticos

Também foi identificado um único caso de golpe utilizando deepfake. Nos 20% restantes dos casos, o DFRLab não conseguiu acessar os materiais brutos para realizar análises.

O uso de IA para permitir desinformação, especialmente a produção de deepfakes, foi uma preocupação central das autoridades eleitorais brasileiras antes das eleições municipais de outubro de 2024, nas quais 150 milhões de pessoas votaram para eleger prefeitos, vereadores e outros representantes locais em 5.568 municípios. Em fevereiro de 2024, o Tribunal Superior Eleitoral (TSE), órgão responsável por organizar e monitorar as eleições, aprovou uma resolução regulando o uso de IA durante a campanha eleitoral de 2024.

Conforme relatado em análises anteriores sobre as novas regras, as regulamentações exigiam que as campanhas fossem transparentes ao disseminar materiais manipulados por ferramentas de IA, como melhorias na qualidade de imagem ou áudio, produção de elementos gráficos ou montagens visuais. Assim, as campanhas eram obrigadas a informar claramente o público sempre que utilizassem IA para criar ou editar conteúdo eleitoral, especificando a ferramenta utilizada. Além disso, as regulamentações proibiam o uso de IA para produzir conteúdo falso ou deepfakes com o objetivo de prejudicar ou favorecer um candidato. Nos casos em que o tribunal eleitoral pudesse comprovar que a campanha de um candidato utilizou qualquer uma dessas táticas, tinha o poder de revogar seu registro eleitoral.

Notavelmente, essas regras se aplicavam ao conteúdo gerado por IA criado pelas próprias campanhas. Conteúdo gerado por IA produzido por indivíduos não vinculados a partidos, candidatos ou campanhas está sujeito às leis civis e criminais.

Monitorando o cenário de informação online

Para compreender melhor o impacto das regulamentações de IA, bem como as táticas, formatos e frequência de deepfakes políticos durante as eleições municipais no Brasil, o DFRLab monitorou redes sociais, sites, blogs e aplicativos de mensagens públicas de 1º de maio a 27 de outubro de 2024. O cronograma da pesquisa incluiu o período pré-campanha (1º de maio a 15 de agosto), a preparação para o primeiro turno (16 de agosto a 6 de outubro) e o segundo turno (de 7 de outubro a 27 de outubro).

A investigação teve como objetivo identificar discussões de usuários online ou relatos que mencionassem deepfakes políticos. O monitoramento utilizou uma variedade de ferramentas e metodologias para identificar menções às palavras-chave “deepfake” e “inteligência artificial” em português, juntamente com variações de grafia e formas no plural.

A pesquisa foi conduzida com base em duas premissas. Primeiro, atualmente não existe um método confiável e eficiente para coletar metadados e analisar conteúdo sintético de forma sistemática, especialmente em diferentes plataformas. Segundo, um grande desafio é que os produtores de deepfakes, com a intenção de disseminar desinformação ou causar danos, não identificariam abertamente seu trabalho como deepfakes; isso torna a detecção ainda mais difícil, especialmente em ambientes propensos a um volume massivo de conteúdo, como em eleições. Dado essas limitações, discussões de usuários ou relatos que mencionem deepfakes políticos – sejam confirmados ou alegados – são métodos valiosos para identificar casos de deepfakes já em domínio público.

A investigação utilizou o Google Alerts para rastrear menções a deepfakes políticos em sites e blogs em português, e a ferramenta de monitoramento de redes sociais Meltwater Explore para identificar discussões relacionadas aos temas “deepfake” e “inteligência artificial” no X (antigo Twitter) de 1º de maio a 27 de outubro. Vale destacar que a plataforma X foi temporariamente banida no Brasil durante a campanha eleitoral. Aplicando as mesmas palavras-chave no Meta, também analisamos postagens e anúncios políticos no Facebook e Instagram.

Além disso, analisamos mensagens de 290 grupos públicos brasileiros no WhatsApp dedicados a discussões políticas, bem como a atividade de 815 perfis oficiais de candidatos e pré-candidatos a prefeito de capitais brasileiras no X, Instagram, Facebook, Telegram e YouTube. Essa análise foi realizada por meio da criação de um painel de contas relevantes na ferramenta de monitoramento de redes sociais Junkipedia.

Mais detalhes sobre nossa abordagem analítica podem ser encontrados na visão geral de nossos métodos de pesquisa, seus pontos fortes e limitações, bem como os desafios na identificação de deepfakes, publicada em parceria com o NetLab da Universidade Federal do Rio de Janeiro (UFRJ) em 2 de outubro de 2024.

Táticas e formatos

O DFRLab identificou 78 casos confirmados ou alegados de deepfakes políticos entre 1º de maio e 27 de outubro. Seis casos retroativos, ocorridos entre dezembro de 2023 e abril de 2024, surgiram durante a coleta de dados, mas não foram incluídos na lista final de incidentes, pois estavam fora dos parâmetros temporais do calendário eleitoral.

Dos 78 casos, 65 foram direcionados a candidatos a prefeito. Os 13 casos restantes incluíram nove relacionados a candidatos a vereador e quatro relacionados a candidatos a vice-prefeito. Esses incidentes ocorreram em 67 cidades, com São Paulo, a maior cidade da América Latina, liderando a lista com oito casos.

Os deepfakes apareceram em diversos formatos, sendo 48 vídeos, 17 clipes de áudio e seis imagens. Em sete casos, o DFRLab não conseguiu confirmar o formato original do conteúdo.

O WhatsApp foi a principal plataforma onde os supostos deepfakes políticos foram disseminados, com 25 incidentes. O Instagram ficou em segundo lugar, com 13 incidentes, seguido pelo TikTok com três, X com dois e YouTube com um. Após a publicação do conteúdo, ele frequentemente se espalhava para outras plataformas.

Em termos de narrativas, vinte e sete incidentes referiam-se a casos em que um candidato foi acusado de crimes, como corrupção, suborno, assédio ou pedofilia, com o objetivo de minar a credibilidade e a reputação do político alvo. Dez casos usaram táticas de personificação de figuras da mídia para enganar os eleitores.

Oito casos enganaram o público sobre eventos políticos, como datas de comícios ou o número de candidatos nas cédulas. Outros oito foram deepfakes políticos satíricos e humorísticos. Cinco casos envolviam deepfakes pornográficos, enquanto quatro empregaram imagens do presidente Luiz Inácio Lula da Silva e do ex-presidente Jair Bolsonaro para enganar os eleitores.

Quarenta e nove dos casos identificados foram relatados às autoridades brasileiras, resultando em investigações ou ações legais.

Deepfakes pornográficos

Cinco candidatas mulheres foram relatadas como vítimas de deepfakes de pornografia, em que a IA foi usada para gerar imagens nuas com aparência realista. Os incidentes ocorreram nas cidades do Rio de Janeiro, São Paulo, Bauru e Taubaté, tendo como alvos as políticas Letícia Arsenio, Tabata Amaral, Marina Helena, Suéllen Rosim e Loreny Caetano.

Em um dos casos, duas imagens deepfake circularam no X retratando Tabata Amaral, candidata à prefeitura de São Paulo. Em uma das imagens, Tabata foi apresentada com a língua de fora e usando orelhas de coelhinha da Playboy. Na outra, a deputada foi retratada em um maiô, posando de forma sugestiva em um sofá. A conta @AQUELECARA publicou as duas imagens em 7 de setembro. O post recebeu 114 comentários, 138 compartilhamentos, 2.200 curtidas e 612 favoritos no momento da análise.

Apropriação da imagem de figuras da mídia

Os rostos de jornalistas brasileiros proeminentes foram amplamente usados em vídeos manipulados por IA para enganar eleitores. Em dez casos, quadros de programas jornalísticos foram editados com IA para promover um candidato ou prejudicar sua reputação.

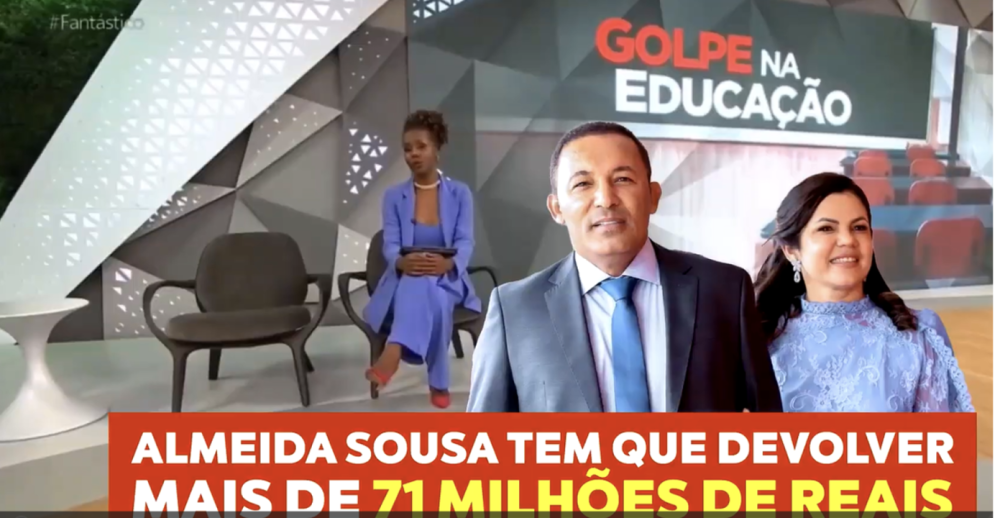

Em Igarapé do Meio, cidade no estado do Maranhão, um vídeo deepfake surgiu no dia 6 de agosto acusando o governo local, incluindo o prefeito Almeida Sousa, de fraude financeira no sistema público de educação. O vídeo manipulou imagens reais transmitidas em janeiro de 2024 pelo programa de TV Fantástico. As imagens originais discutiam crimes financeiros cometidos por autoridades públicas nas cidades de Turiaçu, São Bernardo e São José de Ribamar, todas localizadas no Maranhão.

O vídeo pode ter tido como objetivo prejudicar a reputação do prefeito Sousa, que apoiava a candidatura de sua esposa, Solange Almeida.

Captura de tela do vídeo deepfake acusando o prefeito de Igarapé do Meio de fraude financeira. (Fonte: YouTube)

Captura de tela do vídeo deepfake acusando o prefeito de Igarapé do Meio de fraude financeira. (Fonte: YouTube)

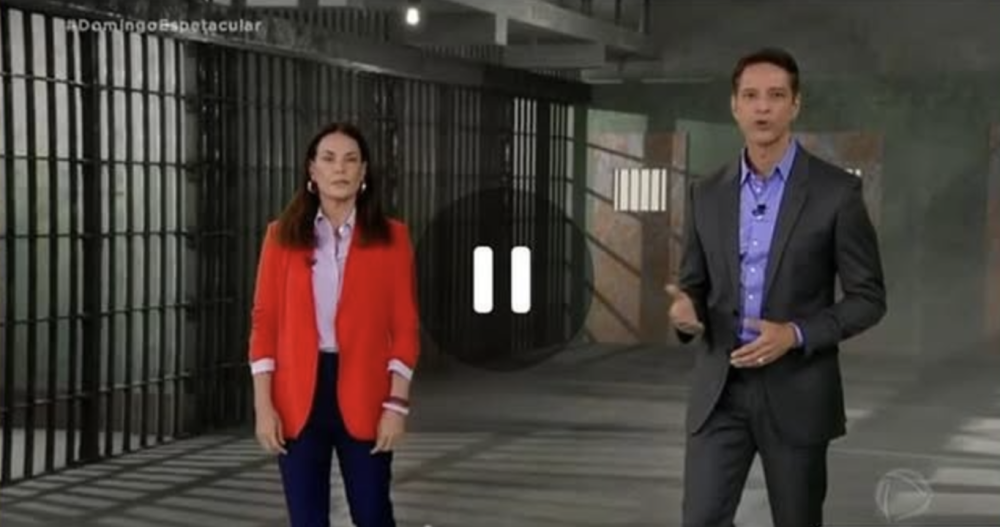

Outro caso surgiu em Fortaleza, capital do Ceará, envolvendo o candidato à prefeitura Evandro Leitão. Um vídeo manipulado conectava falsamente políticos locais do Ceará à maior organização criminosa do Brasil, conhecida como Primeiro Comando da Capital (PCC), utilizando imagens do programa de TV Domingo Espetacular.

Captura de tela do suposto vídeo deepfake conectando falsamente políticos locais do Ceará à organização criminosa PCC. (Fonte: @evandroleitao/arquivo)

Captura de tela do suposto vídeo deepfake conectando falsamente políticos locais do Ceará à organização criminosa PCC. (Fonte: @evandroleitao/arquivo)

Em Itapecuru Mirim, no Maranhão, e João Pessoa, capital da Paraíba, os candidatos Ricardo Lages e Eliza Virginia publicaram vídeos deepfake em suas contas nas redes sociais. Esses vídeos promoviam os candidatos imitando o jornalista William Bonner, âncora do Jornal Nacional, o programa jornalístico mais assistido do Brasil.

“A equipe de campanha do Dr. Ricardo acaba de anunciar que, em breve, trará uma grande notícia que será crucial para a eleição em Itapecuru”, afirmou o âncora deepfake em um vídeo publicado pelo candidato a prefeito Ricardo Lages em sua conta no Instagram.

A versão compartilhada por Eliza Virginia mostrava Bonner afirmando que ela era “a melhor candidata a vereadora para 2024”. O vídeo foi postado no WhatsApp.

Capturas de tela dos vídeos deepfake utilizando o rosto do jornalista brasileiro William Bonner. (Fonte: Eliza Virginia Novo via Stories do WhatsApp, à esquerda; @dr.ricardolages, à direita)

Capturas de tela dos vídeos deepfake utilizando o rosto do jornalista brasileiro William Bonner. (Fonte: Eliza Virginia Novo via Stories do WhatsApp, à esquerda; @dr.ricardolages, à direita)

Eventos Políticos

Outra tática identificada pelo DFRLab foi o uso de deepfakes para enganar eleitores sobre eventos políticos ou o processo eleitoral de forma mais ampla. Em oito casos, supostos deepfakes buscaram causar confusão sobre cédulas, locais de votação e assuntos similares.

Em Monsenhor Gil, cidade localizada no estado do Piauí, um perfil no Instagram publicou um vídeo deepfake no qual o candidato a prefeito Evandro Abreu parecia estar induzindo os eleitores ao erro sobre como preencher as cédulas de votação. A conta foi suspensa no primeiro turno da eleição por divulgar desinformação.

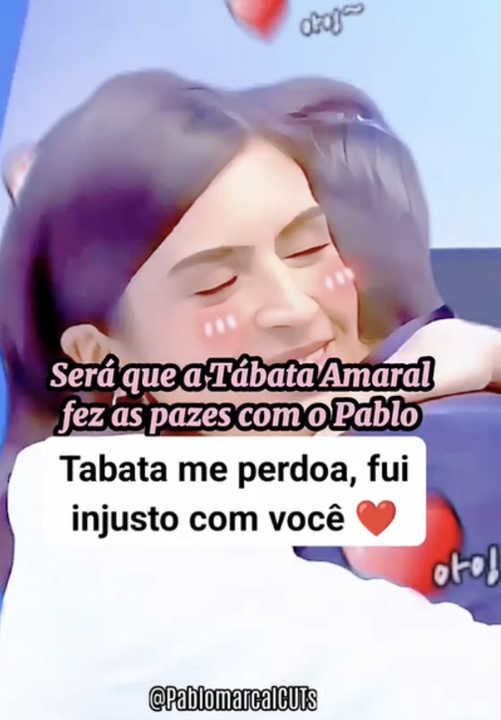

Em 25 de setembro, um usuário compartilhou um vídeo alterado em um grupo público no WhatsApp apresentando a candidata à prefeitura de São Paulo, Tabata Amaral, onde ela aparentemente abraçava seu oponente político, Pablo Marçal, durante um debate. O vídeo incluía as legendas “Tabata, me perdoe, fui injusto com você” e “Será que Tabata perdoará Marçal?”. O vídeo tinha como objetivo distorcer a imagem de Marçal, representando-o como se estivesse admitindo ofensas pessoais contra Amaral. Ao final do vídeo, os dois candidatos foram falsamente retratados se abraçando, rodeados por emojis de coração vermelho e a frase “Te amo”.

Um vídeo deepfake falsamente retrata dois candidatos se abraçando em um debate político em São Paulo. (Fonte: Patriotas Unidos Sempre via WhatsApp)

Um vídeo deepfake falsamente retrata dois candidatos se abraçando em um debate político em São Paulo. (Fonte: Patriotas Unidos Sempre via WhatsApp)

Apropriação da imagem de políticos brasileiros

As reputações políticas do Presidente Luiz Inácio Lula da Silva e do ex-Presidente Jair Bolsonaro foram usadas para apoiar ou prejudicar campanhas de candidatos. Quatro deepfakes identificados retrataram Lula e Bolsonaro em áudios e vídeos manipulados.

Em agosto, um vídeo no TikTok mostrava Bolsonaro pedindo a seus apoiadores que votassem no candidato Pablo Marçal, em São Paulo. “Apesar de diferenças e discussões passadas, quero expressar meu apoio ao Pablo Marçal,” dizia o Bolsonaro gerado por IA no vídeo. “Peço a todos os meus amigos e apoiadores que também apoiem o Pablo Marçal.”

O vídeo inclui uma marca d’água da conta do TikTok @capitao.jairbolsonaro, sugerindo que este perfil pode ter publicado originalmente o vídeo. Embora o nome de usuário inclua o nome do ex-presidente, não se trata de uma conta oficial.

Captura de tela de um vídeo deepfake publicado no TikTok no qual Bolsonaro falsamente declara apoio ao candidato Pablo Marçal em São Paulo. (Fonte: @ThiagoBagatin/arquivo)

Captura de tela de um vídeo deepfake publicado no TikTok no qual Bolsonaro falsamente declara apoio ao candidato Pablo Marçal em São Paulo. (Fonte: @ThiagoBagatin/arquivo)

Bolsonaro e Marçal se envolveram em uma série de disputas públicas durante as eleições. Marçal buscava o apoio oficial do ex-presidente na corrida pela prefeitura de São Paulo, mas Bolsonaro apoiou outro candidato, Ricardo Nunes.

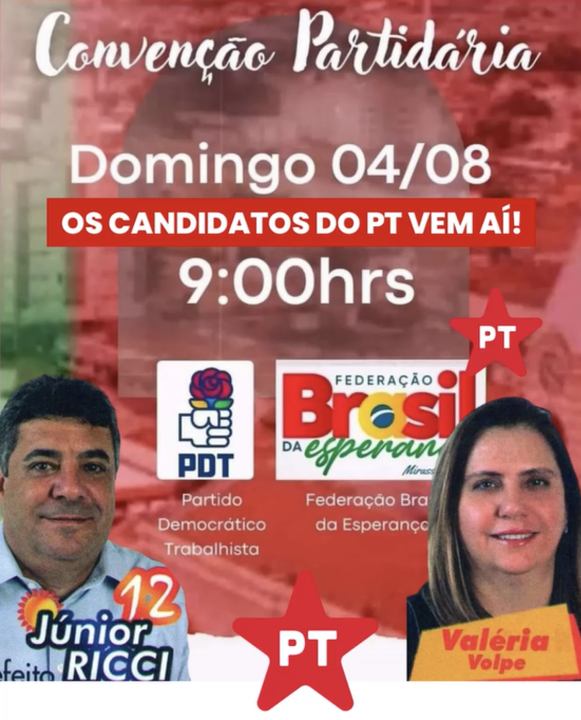

Em outra ocasião, na cidade de Mirassol, localizada no estado de São Paulo, um vídeo deepfake circulou em grupos públicos do WhatsApp retratando os candidatos Junior Ricci e Valéria Volpe como apoiadores do Partido dos Trabalhadores (PT), associado a Lula. No entanto, os dois candidatos pertencem a um partido político diferente. O vídeo alterado apresentava uma imagem estática dos candidatos e um convite para um evento político em 4 de agosto. Também incluía um áudio falsificado de Lula supostamente dizendo: “Atenção! Esquerdistas de Mirassol, venham para a convenção do partido.”

Captura de tela de um vídeo deepfake que utilizou áudio falsificado do Presidente Lula. (Fonte: Justiça Eleitoral, 072ª Zona Eleitoral de Mirassol via WhatsApp)

Captura de tela de um vídeo deepfake que utilizou áudio falsificado do Presidente Lula. (Fonte: Justiça Eleitoral, 072ª Zona Eleitoral de Mirassol via WhatsApp)

Deepfakes humorísticos

O DFRLab identificou oito exemplos de deepfakes políticos satíricos e humorísticos. Embora esse formato não tenha a intenção de enganar, em determinados contextos, ele tem o potencial de distorcer a percepção pública dos eventos.

O humor foi utilizado para prejudicar ou promover a reputação de candidatos. Por exemplo, Bruno Reis, candidato à prefeitura de Salvador, na Bahia, criou e publicou dois vídeos deepfake promocionais em setembro, em sua conta no Instagram, nos quais ele aparece dançando ao som de seus jingles de campanha.

Capturas de tela de dois vídeos editados por IA e publicados no Instagram pelo candidato Bruno Reis em setembro. (Fonte: @brunoreisba, acima; @brunoreisba, abaixo)

Capturas de tela de dois vídeos editados por IA e publicados no Instagram pelo candidato Bruno Reis em setembro. (Fonte: @brunoreisba, acima; @brunoreisba, abaixo)

Em outro exemplo, Brian Masçon, candidato a vereador em Baependi, uma cidade localizada em Minas Gerais, publicou um vídeo deepfake em sua conta no Facebook. O vídeo utilizava um meme popular no Brasil, no qual uma garota reclama sobre um show. O rosto da garota foi substituído pelo de Masçon, e um áudio foi adicionado com ele dizendo: “Nestas eleições, o Brian não pode ficar de fora. Eu trabalho todos os dias até as 3 da manhã. Que tipo de Baependi é esse?”

Captura de tela de um deepfake imitando um meme compartilhado por Brian Masçon para promover sua campanha. (Fonte: @brianmascon33000)

Captura de tela de um deepfake imitando um meme compartilhado por Brian Masçon para promover sua campanha. (Fonte: @brianmascon33000)

O mesmo meme foi utilizado em outro deepfake direcionado ao candidato a prefeito Thiago Silva, em Rondonópolis, cidade no Mato Grosso. O político afirmou que o vídeo foi editado por seus oponentes e compartilhado no WhatsApp com o objetivo de prejudicar sua reputação. Ele acrescentou que havia denunciado o incidente às autoridades eleitorais.

Captura de tela de um suposto histórico de conversa em grupo no WhatsApp, no qual um deepfake direcionado ao candidato Thiago Silva foi publicado. (Fonte: RDNews/arquivo)

Captura de tela de um suposto histórico de conversa em grupo no WhatsApp, no qual um deepfake direcionado ao candidato Thiago Silva foi publicado. (Fonte: RDNews/arquivo)

Credibilidade prejudicada por má conduta

A forma mais comum de deepfakes observada envolveu a publicação de alegações de má conduta para prejudicar a credibilidade de um candidato. Identificamos vinte e sete casos em que candidatos foram acusados de crimes, infrações ou comportamentos imorais por meio de conteúdo deepfake, frequentemente apresentados como mídia vazada.

Em Ribeirão Pires, São Paulo, o candidato a prefeito Gabriel Roncon relatou ser vítima de um vídeo no WhatsApp que continha áudio gerado por IA supostamente em sua voz. No áudio, ele parecia admitir ter manipulado os resultados de uma pesquisa eleitoral.

Em Vitória do Xingu, Pará, o prefeito Márcio Viana denunciou às autoridades locais ser vítima de um vídeo deepfake compartilhado em grupos de WhatsApp. O vídeo mostrava um homem em um momento íntimo com uma adolescente, e o texto que acompanhava o vídeo alegava que o homem era o prefeito.

Em vários casos, candidatos vítimas de deepfakes defenderam-se publicamente por meio de suas contas nas redes sociais. Isso incluiu seis casos em que os candidatos patrocinaram anúncios em plataformas da Meta para ampliar a divulgação de que foram alvos de deepfakes.

Em certas ocasiões, candidatos tentaram refutar ou lançar dúvidas sobre todos os conteúdos vazados, mesmo aqueles que pareciam autênticos. Isso demonstra como a disseminação de mídia manipulada pode simultaneamente minar a credibilidade de conteúdos autênticos, criando uma situação conhecida como "dividendo do mentiroso". Por exemplo, em Fortaleza, o candidato à prefeitura André Fernandes usou suas redes sociais para afirmar que foi alvo de um suposto áudio deepfake circulando no WhatsApp, que imitava sua voz. Ele acusou seu oponente, Evandro Leitão, de criar o deepfake, no qual Fernandes supostamente discutia distribuir dinheiro a pastores e líderes comunitários para comprar votos, após cair nas pesquisas para o segundo turno da eleição municipal. Até o momento da escrita, o candidato ainda não havia apresentado provas de que o áudio era falso. Além disso, a organização de checagem de fatos Projeto Comprova submeteu o áudio para análise por especialistas e ferramentas para identificar deepfakes, mas os resultados foram inconclusivos.

Em Palmas, capital do Tocantins, outro caso envolvendo um suposto deepfake também permanece inconclusivo. Em 23 de setembro, o candidato à prefeitura Professor Júnior Geo transmitiu na televisão um áudio atribuído à sua oponente, Janad Valcari. No áudio, a voz atribuída a Janad tratava um funcionário de forma agressiva, chamando-o de “idiota”. Essa gravação foi amplamente compartilhada em grupos de WhatsApp durante a campanha eleitoral, mas Janad contestou sua autenticidade, alegando que se tratava de um áudio deepfake. O caso está atualmente sob investigação.

Supostos deepfakes que não envolviam IA

Como a pesquisa se concentrou em discussões de usuários e reportagens sobre casos de deepfakes durante o calendário eleitoral, identificou-se várias situações em que conteúdos foram erroneamente considerados gerados por IA, quando na verdade haviam sido simplesmente editados sem o uso de ferramentas de IA.

O DFRLab observou que essas descrições imprecisas persistiram não apenas entre candidatos, mas também entre juízes e autoridades que examinavam possíveis violações das regulamentações eleitorais. Por exemplo, em Gravataí, uma cidade no estado do Rio Grande do Sul, um juiz eleitoral ordenou que o candidato a vereador Paulo Silveira removesse um suposto deepfake de sua conta no Instagram. Esse conteúdo teria como alvo o candidato a prefeito Luiz Zaffalon e seu vice, Levi Melo. A ação judicial foi iniciada pelos dois candidatos, que alegaram que Silveira publicou uma imagem alterada em sua conta no Instagram retratando-os como palhaços. A foto estava acompanhada de uma crítica ao serviço público de saúde local.

Captura de tela de uma imagem alterada que foi alegada ser um deepfake. (Fonte: @paulosilveira40)

Captura de tela de uma imagem alterada que foi alegada ser um deepfake. (Fonte: @paulosilveira40)

No caso legal, Zaffalon e Melo alegaram que o conteúdo em questão era um “deepfake” porque apresentava as cabeças dos candidatos nos corpos de diferentes personagens. Eles também solicitaram a revogação do registro eleitoral do vereador.

Em uma decisão preliminar, a juíza eleitoral Valéria Eugênia Neves Wilhelm aceitou a alegação e ordenou a remoção imediata do conteúdo. No entanto, em uma decisão subsequente, o juiz Régis Pedrosa Barros rejeitou a classificação da imagem como um deepfake, reconhecendo-a como uma edição básica de imagem. “Embora a imagem incluída com a mensagem seja de muito mau gosto e possa até gerar pedidos de danos morais na justiça civil, não se trata de um deepfake, mas sim de uma montagem grosseira,” afirmou ele.

Os casos analisados pelo DFRLab revelam confusões decorrentes não apenas do mal-entendido sobre a definição de deepfakes, mas também da falta de clareza nas regulamentações eleitorais quanto à classificação de conteúdo sintético. Além disso, o acesso limitado a ferramentas para verificar a autenticidade de mídias deepfake permitiu que essa confusão persistisse no ambiente informacional.

Cite esse estudo de caso:

Beatriz Farrugia, “Brazil’s electoral deepfake law tested as AI-generated content targeted local elections,” Digital Forensic Research Lab (DFRLab), November 26, 2024,

Originalmente publicado em inglês em: <https://dfrlab.org/2024/11/26/brazil-election-ai-deepfakes/>

Foto da capa: Banner: Vídeo manipulado por IA compartilhado pelo candidato a prefeito de Salvador, Bruno Reis, mostrando-o dançando sua música de campanha em diferentes locais. (Fonte: @brunoreisba)